Современный искусственный интеллект дает невероятные возможности в развитие науке, образовании, промышленности. ИИ развивается быстрыми темпами, но одновременно с этим набирают обороты и киберпреступники.

Нейросети прочно вошли в нашу жизнь, и сложно найти сферу экономики, где бы не использовался искусственный интеллект (ИИ). Одновременно с этим нейросети несут определенный риск для безопасности людей, так как инновационные технологии нередко применяются в целях мошенничества.

- Как мошенники используют нейросети, чтобы нас обманывать?

- Способы мошенничества с использованием искусственного интеллекта

- Доверять своим ушам больше не стоит!

- Шантаж и сбор средств на благотворительность

- Создание фишинговых писем

- Как не стать жертвой мошенников!

- Главные правила которые нужно соблюдать находясь в интернете!

Как мошенники используют нейросети, чтобы нас обманывать?

Злоумышленники применяют алгоритмы машинного обучения и используют нейронные сети, чтобы получить доступ к личной информации людей для обмана. С помощью нейросетей можно генерировать скрипты для общения с жертвой.

Также нейросети могут быть использованы для массовых обзвонов. Вы наверняка помните моменты, когда вам звонят и молчат, или поступает звонок от неизвестного абонента, который рассказывает свою очередную байку, предлагает любые услуги, представляются сотрудником банка, следователем, полицейским или другими служащими.

Злоумышленники все чаще применяют алгоритмы машинного обучения и используют нейросети для получения доступа к личной информации граждан с целью мошенничества.

Способы мошенничества с использованием искусственного интеллекта

- С помощью искусственного интеллекта злоумышленники могут делать фальшивые документы: нейросеть подделает банковские выписки, нарисует фальшивый паспорт или водительское удостоверение.

- Мошенники могут использовать нейросети для создания фейковых новостей и рассылок. В них включаются различные ссылки на ресурсы, при переходе по которым можно потерять данные своей банковской карты или другую персональную информацию.

- Нейросети позволяют создавать фальшивые отзывы и рейтинг.

- Чат-боты с легкостью могут придумать сценарий для телефонного звонка и облегчить работу преступникам.

- Нейросети учатся поддерживать разговор. ИИ может взять на себя роль мнимых сотрудников контакт-центров банков и других организаций, которыми представляются мошенники для обмана свои жертв.

- ИИ может создавать «клон» голоса человека (deepfake). С учетом развития биометрии и возможности оформить кредит по звонку (современные технологии идентифицируют человека по тембру голоса), нейросети на службе у мошенников могут доставить немало бед. Ведь будет иметь стопроцентную схожесть с оригиналом, а значит, жертва рискует остаться в должниках, ничего об этом не зная.

- Нейросети мастерски умеют создавать картины и иллюстрации. А это значит, что подобные изображения легко используются для фейковых сборов. Так что перед тем, как отправить кому-то финансовую помощь, стоит проверить в других соцсетях и интернете «реальность» адресата.

В арсенале злоумышленников имеется немало способов применения нейросетей в целях мошенничества. Это могут быть как подделка документов и голосовые дипфейки (подделка голоса), так и организация сбора средств якобы на благотворительные цели, шантаж с использованием поддельных видео- и фотодокументов, а также фишинговые рассылки для сбора личных данных.

Нейросети способны достаточно быстро генерировать поддельные паспорта, водительские удостоверения и банковские выписки. Да что говорить о фальсификации документов, когда нейросеть может скопировать даже личность конкретного человека, проанализировав его стиль письма в соцсетях, и это тоже нередко используется для совершения мошенничества!

С распространением дипфейков появились случаи «дискредитации» публичных личностей, чьих изображений много в открытом доступе. Например, весной 2019 года в Сети было опубликовано дипфейк-видео со спикером палаты представителей конгресса США Нэнси Пелоси. Автор ролика с помощью ИИ изменил речь Пелоси так, что она плохо выговаривала слова, и пользователи, посмотревшие видео, посчитали, что политик пьяна. Ситуация вылилась в громкий скандал, и лишь спустя некоторое время было доказано, что речь Пелоси была сгенерирована ИИ.

Доверять своим ушам больше не стоит!

Нейросеть может написать письмо вашим родственникам и сообщить, что вы якобы попали в сложную ситуацию — для решения проблемы вам срочно требуются деньги. Кроме того, в целях совершения мошенничества может быть клонирован ваш голос — для этого используется технология синтеза речи (deep voice technology).

Злоумышленники способны создать запись вашего голоса, который будет говорить еще и вашими фразами. Например, известны случаи мошенничества, когда родители получали аудиозапись с голосом ребенка, который рассказывал, что его похитили и необходимо внести выкуп.

Есть три основные причины почему мошенники используют ИИ. Самая главная причина, чтобы использовать нейросети, так это не нужно быть программистом. Эта простота привлекает мошенников.

Второй причиной является то, что нейросети показывают стабильно хороший результат, исключающий фактор человеческий ошибки, а третья причина — высокая скорость работы. Все это вместе взятое создает практически неограниченные возможности для использования нейросетей в целях мошенничества.

Шантаж и сбор средств на благотворительность

Еще одним излюбленным способом мошенничества у злоумышленников является благотворительность и сбор пожертвований. Эти схемы не новы, и несмотря на большую информационную кампанию в СМИ число потерпевших постоянно растет.

Кроме того, нейросети способны генерировать фейковые интимные изображения на основе реальных фотографий из социальных сетей — этим организаторы мошенничества активно пользуются для того, чтобы шантажировать своих жертв.

Создание фишинговых писем

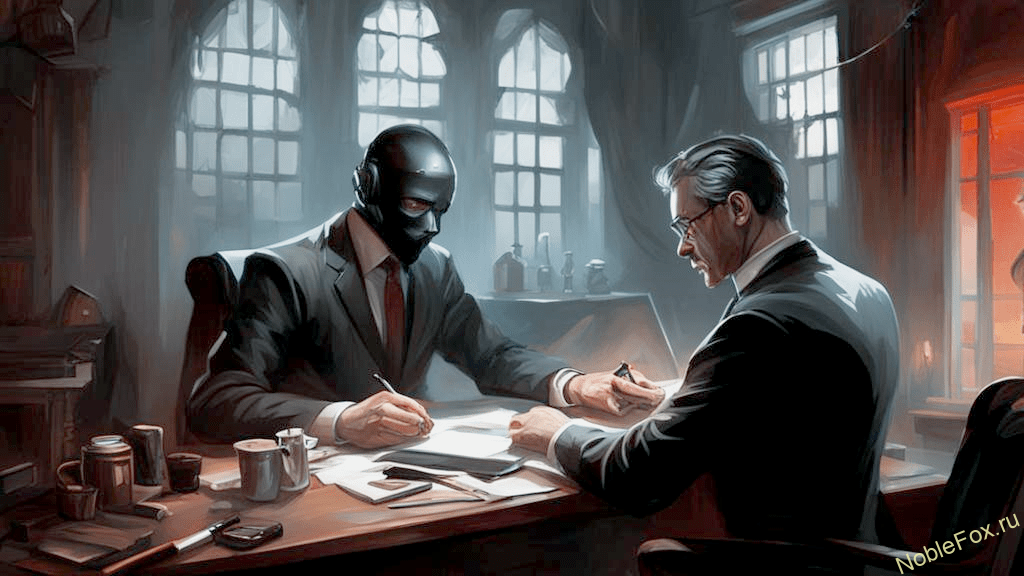

Еще одним популярным видом мошенничества является использование фишинговых писем, содержащих вредоносные ссылки. С помощью нейросетей, задача мошенников, это составить письмо таким образом, чтобы пользователь проникся, поверил и кликнул по вредоносной ссылке.

ИИ способен создать портрет личности человека по анализу профиля из социальных сетей, где можно получить исчерпывающую информацию о том, что для человека ценно, какими новостями и событиями он интересуется, какие места посещает. Это многофакторный анализ, позволяющий формулировать индивидуальные письма, доверие к которым будет намного выше.

ВНИМАНИЕ! Любители бесплатного, будет интересно почитать! — Как мошенники используют торрент-трекеры?

Как не стать жертвой мошенников!

Чтобы не стать жертвой мошенников, не стоит переходить по разным ссылкам, непонятно приходящих от кого, даже от друзей, ведь их аккаунт могли взломать и рассылать с него спам.

Будьте очень внимательны в социальных сетях и мессенджерах, в таких как; WhatsApp, Viber, Skype, Snapchat, Discord, Microsoft Teams, Threema, WeChat и других!

К примеру, в социальной сети ваш знакомый, друг, родственник написал вам сообщение, что у него беда, ему срочно нужны деньги, или еще что-то подобное. Никогда не введитесь на это, лучше позвоните ему лично и уточните.

Не стоит отвечать на звонки с незнакомых номеров. Кроме того, если вы в разговоре почувствовали что-то неладное, лучше всего будет задать собеседнику случайный вопрос, к примеру – Чей Крым?

Основная часть мошеннических звонков и рассылки спама идет с Украины. Там существуют целые официальные структуры, со своим штатом сотрудников, финансированные США и Западом, направленные именно для вредительства гражданам РФ. Здесь для них это все равно, что запустить ракету по мирным жителям или просто всячески им навредить, использую любые возможности для этого, тем более интернет и сотовую связь.

Главные правила которые нужно соблюдать находясь в интернете!

- 1. Нужно быть осторожным при вводе личной информации на веб-сайтах и не открывать подозрительные электронные письма.

- 2. Лично проверять всю информацию поступающую от друзей или родственников в соцсетях, мессенджерах. То есть, если подруга вдруг попросила денег, чтобы оплатить посылку, лучше перезвонить и услышать просьбу в разговоре.

- 3. В социальных сетях нельзя давать никакой личной информации незнакомым людям. Это может стать ключиком для дальнейшего удачного обмана.

- 4. Важно использовать антивирусное программное обеспечение и регулярно обновлять его, чтобы защитить свой компьютер от вредоносных программ.

- 5. Если в ходе общения в мессенджере бот или робот предлагает ввести личную финансовую информацию (коды из смс от банка, полные данные карты, ФИО, паспортные данные и т. д.) необходимо прервать общение, обратиться в отделение банка либо самостоятельно связаться с организацией по официальным контактам, которые указаны на официальном сайте компании.

- 6. Если вы решили самостоятельно воспользоваться услугами нейросети, убедитесь, что действительно оказались на официальном ресурсе. Не переходите по сомнительным ссылкам, предлагающим ввести данные для оплаты и не устанавливайте на свои устройства неизвестные приложения.

- 7. Не используйте торрент сайты и программы использующие торрент файлы.

Будьте очень внимательны, ведь сидя в уютной комнате за экраном своего компьютера, вы считаете себя совершенно в безопасности, но как только потеряли бдительность и внимательность, то вы можете оказаться совсем не защищенным, взломанным и облапошенным!